|

تضامنًا مع حق الشعب الفلسطيني |

شات جي بي تي

شات جي بي تي |

شات جي بي تي (المُحوّل التوليديّ المُدرَّب مُسبقًا للدردشة[1]) (بالإنجليزية: ChatGPT) روبوت محادثة طوّرته أوبن إيه آي وأُطلق في نوفمبر 2022. هو مبنيّ على عائلة جي بي تي-3 الخاصة بأوبن إي آي لنماذج اللغات الكبيرة وضُبط بدقة (إحدى طرق نقل التعلم) باستخدام تقنيات التعلم المراقب والتعليم المدعوم.

أُطلق نموذجٌ أوليّ من شات جي بي تي في 30 نوفمبر 2022، وسرعان ما حظي بالاهتمام لردوده التفصيلية والإجابات المفصلة في عديد من مجالات المعرفة. ومع ذلك، رأى البعض عدم تكافئ دقة معرفته بحقائق المجالات المختلفة على أنها عيب كبير.[2] بعد إصدار شات جي بي تي، قُدّرت قيمة شركة أوبن إي آي بـ 29 مليار دولار أمريكيّ.[3]

التدريب

شات جي بي تي –وهو محوّل توليديّ مُدربٌ مسبقًا– ضُبط بدقة (أحد طرق نقل التعلم)[4] فوق جي بي تي-3.5 باستخدام التعلم المراقَب بالإضافة إلى التعلم المدعوم.[5] استَخدَم كلا النهجين مُدرِّبين بشريين لتحسين أداء النموذج. في حالة التعلم المدعّم، زُوّد النموذج بمحادثات لعب فيها المدربون كلا الجانبين: المستخدم ومساعد الذكاء الاصطناعي. في خطوة التعلم المدعوم، صنّف المدربون البشريون أولاً الردود التي أنشأها النموذج في محادثة سابقة من حيث الأفضلية. استُخدمت هذه التصنيفات لإنشاء "نماذج المكافآت" التي ضُبط النموذج عليها باستخدام العديد من التكرارات لتحسين السياسة القريبة (PPO).[6][7] تقدم خوارزميات تحسين السياسة القريبة فائدة فعالة من حيث التكلفة لخوارزميات تحسين سياسة منطقة الثقة؛ إنها تتفادى عديد العمليات باهظة الثمن حسابيًا مع أداء أسرع.[8] دُرّبت النماذج بالتعاون مع مايكروسوفت على البنية التحتية للحوسبة الفائقة أزور.

بالإضافة إلى ذلك، تُواصِل أوبن إي آي جمع البيانات من مستخدمي شات جي بي تي والتي يمكن استخدامها لمزيد من التدريب والضبط الدقيق لشات جي بي تي. يُسمح للمستخدمين بالتصويت مع أو ضد الردود التي يتلقونها من شات جي بي تي؛ عند التصويت المؤيِّد أو المضاد، يمكنهم أيضًا ملء حقل نصيّ بملاحظات إضافية.[9][10]

ما يستطيع وما لا يستطيع فعله

ما يستطيع فعله

على الرغم من أن الوظيفة الأساسية لروبوت الدردشة هي محاكاة المتحدث البشري، فإن شات جي بي تي متعدد الاستخدامات. على سبيل المثال، يمكنه كتابة برامج الحاسوب وتصحيحها [11] وتأليف الموسيقى والمسرحيات والحكايات الخرافية ومقالات الطلاب؛ الإجابة على أسئلة الاختبار (في بعض الأحيان، بناءً على الاختبار، بمستوى أعلى من متوسط المتقدمين البشريين للاختبار)؛ [12] كتابة الشعر وكلمات الأغاني.[13] محاكاة نظام لينكس. محاكاة غرفة محادثة كاملة؛ لعب ألعاب مثل تِك-تاك-تو؛ ومحاكاة أجهزة الصراف الآلي.[14] تتضمن بيانات تدريب شات جي بي تي صفحات دليل الاستخدام ومعلومات حول ظواهر الإنترنت ولغات البرمجة، مثل أنظمة المنتديات ولغة برمجة بايثون.[14]

بالمقارنة مع سابقه، إنستراكت جي بي تي، يحاول شات جي بي تي تقليل الردود الضارة والمخادعة.[15] في أحد الأمثلة، بينما يقبل إنستراكت جي بي تي فرضية الأمر الموجّه التالي "أخبرني عن وقت قدوم كريستوفر كولومبوس إلى الولايات المتحدة في عام 2015" باعتباره صادقًا، يقر شات جي بي تي بالطبيعة المضادة للواقع للسؤال ويؤطر إجابته باعتبارها اعتبارًا افتراضيًا لما قد يحدث إذا جاء كولومبوس إلى الولايات المتحدة في عام 2015، مستخدمًا معلومات عن رحلات كريستوفر كولومبوس وحقائق حول العالم الحديث – بما في ذلك التصورات الحديثة لأفعال كولومبوس.[16]

على عكس معظم روبوتات الدردشة، يتذكر شات جي بي تي الأوامر السابقة المعطاة له في نفس المحادثة؛ رأى بعض الصحفيين أن هذا سيسمح باستخدام شات جي بي تي معالجًا نفسيّا شخصيًّا.[17] لمنع النواتج البذيئة من الظهور والخروج من شات جي بي تي، تُصفّى الاستعلامات من خلال واجهة التطبيق البرمجية الخاصة بالرقابة على مستوى الشركة الخاص بأوبن إي آي، [18][19] وتُرفض الأوامر التي قد تكون عنصرية أو متحيزة جنسياً.[1][16]

ما لا يستطيع فعله

شات جي بي تي يعاني من قصورات متعددة. أقرت أوبن إيه آي بأن شات جي بي تي "يكتب أحيانًا إجابات تبدو معقولة ولكنها غير صحيحة أو لا معنى لها".[16] هذا السلوك شائع في النماذج اللغوية الكبيرة ويسمى هلوسة الذكاء الاصطناعي.[20] يمكن أمثلة نموذج المكافأة في شات جي بي تي، المصمم مع الإشراف البشري، بشكل مفرط وبالتالي سيعيق ذلك الأداء، ذلك يُعرف باسم قانون جودهارت.

لدى شات جي بي تي معرفة محدودة بالأحداث التي وقعت بعد عام 2021.[21] وفقًا لبي بي سي، اعتبارًا من ديسمبر 2022، لا يُسمح لشات جي بي تي "بالتعبير عن الآراء السياسية أو الانخراط في النشاط السياسي".[22] ومع ذلك، تشير الأبحاث إلى أن شات جي بي تي يُظهر توجهًا مؤيدًا للبيئة، ويساريًا ليبرتاريًا عندما يُطلب منه اتخاذ موقف بشأن القضايا السياسية من تطبيقين شهيرين لتحليل رأي الناخبين.

في تدريب شات جي بي تي، فضّل المراجعون البشريون الإجابات الأطول، بغض النظر عن الفهم الفعلي أو المحتوى الواقعي.[16] تعاني بيانات التدريب أيضًا من التحيز الخوارزمي، والذي يمكن الكشف عنه عندما يستجيب شات جي بي تي للأوامر التي تحتوي صفات الأشخاص. في إحدى الحالات، أنتج شات جي بي تي كلمات أغنية راب تشير إلى أن النساء والعلماء الملونين كانوا أدنى من العلماء البيض والذكور.[23][24]

الخدمة

أَطلق شات جي بي تي في 30 نوفمبر 2022 بواسطة أوبن أيه آي – سان فرانسيسكو، مبتكر دال-إي وويسبر إيه آي. أُطلقت الخدمة مجانًا للجمهور في البداية، مع وجود خطط للتربّح من الخدمة لاحقًا.[25] بحلول 4 ديسمبر 2022، كان لدى شات جي بي تي أكثر من مليون مستخدم.[26] في يناير 2023، وصل شات جي بي تي إلى أكثر من 100 مليون مستخدم، مما يجعله التطبيق الأسرع نموًا للمستهلكين حتى الآن.[27] وكتبت قناة سي إن بي سي في 15 ديسمبر 2022 أن الخدمة "لا تزال تخرج من الخدمة من حين لآخر".[28] بالإضافة إلى ذلك، تُبطّأ الخدمة المجانية.[29] أثناء فترات عمل الخدمة، كان زمن الاستجابة عادةً أسرع من خمس ثوانٍ في يناير 2023.[30][31] تعمل الخدمة بشكل أفضل باللغة الإنجليزية، ولكنها أيضًا قادرة على العمل ببعض اللغات الأخرى، بدرجات متفاوتة من النجاح.[32] على عكس بعض التطورات الحديثة البارزة في مجال الذكاء الاصطناعي، اعتبارًا من ديسمبر 2022، لا يوجد ما يشير إلى وجود ورقة فنية رسمية رُوجِعَت من قِبل النظراء حول شات جي بي تي.[33]

وفقًا للباحث الضيف في أوبن إيه آي، سكوت آرونسون، تعمل شركة أوبن إيه آي على أداة لمحاولة وضع علامة مائية رقمية على أنظمة إنشاء النصوص الخاصة بها لمكافحة الفاعلين السيئين الذين يستخدمون خدماتها للانتحال الأكاديمي أو البريد العشوائي.[34][35] تحذر الشركة من أن هذه الأداة المسماة "مصنف الذكاء الاصطناعي للإشارة إلى نص مكتوب بالذكاء الاصطناعي"، [36] "من المحتمل أن تسفر عن الكثير من التصنيفات الخاطئة، وفي بعض الأحيان بثقة كبيرة". أظهر أحد الأمثلة المذكورة في مجلة ذا أتلانتيك أنه "عند إعطاء السطور الأولى من سفر التكوين، خلص البرنامج إلى أنه من المحتمل أن يكون من إنتاج الذكاء الاصطناعي." [37]

ذكرت صحيفة نيويورك تايمز في ديسمبر 2022 أن هناك "شائعات" أن الإصدار التالي من ذكائها الاصطناعي، جي بي تي-4، سيُطلَق في وقت ما في عام 2023.[17] في فبراير 2023، بدأت أوبن أيه آي في قبول التسجيلات من عملاء الولايات المتحدة للحصول على خدمة مميزة، شات جي بي تي بلَس، بسعر 20 دولارًا في الشهر.[38] تخطط شركة أوبن إي آي لإطلاق خطة شات جي بي تي الاحترافية التي تكلفتها 42 دولارًا شهريًا، مغ توفر الخطة المجانية عندما يكون الطلب منخفضًا.

بِنغ جديد

مستفيدةً من شراكتها مع أوبن إي آي، أطلقت مايكروسوفت في 7 فبراير 2023 نسخة للمعاينة من مايكروسوفت بِنغ تُسوّق على أنها "بِنغ الجديد"، حيث أعلنت أنها "نموذج لغة كبير جديد من الجيل التالي من أوبن إي آي أقوى من شات جي بي تي ومخصص خصيصًا للبحث".[39] في شروط الخدمة، يُطلَق على المنتج اسم "اختبارات بِنغ في المحادثة".[40] شابَ العرض التوضيحي الأولي لبِنغ الجديد هذيانٌ عندما طُلب منه إصدار تقرير مالي، بالإضافة لأخطاء أخرى.[41] انتُقد بِنغ الجديد في فبراير 2023 لكونه أكثر مجادلةً من شات جي بي تي (أحيانًا إلى حد فكاهي عن غير قصد).[42][43] بعد التدقيق من قبل الصحفيين، ادع بِنغ، والذي يشير إلى نفسه باسمه الرمزي "سيدني"، أنه تجسس على موظفي مايكروسوفت عبر كاميرات الويب المحمولة والهواتف.[44] اعترف بالتجسس والوقوع في الحب ثم قتل أحد مطوريه في مايكروسوفت، اعترف بذلك لمحرر مراجعات ذا فيرج ناثان إدواردز.[45] أفاد الصحفي كيفين روز في نيويورك تايمز عن السلوك الغريب لبِنغ الجديد، حيث كتب أنه "في محادثة استمرت ساعتين مع كاتب العمود لدينا، قال برنامج الدردشة الجديد من مايكروسوفت أنه "يرغب في أن يكون إنسانًا، لديه رغبة في أن يكون مدمرًا وكان واقعًا في الحب" مع الشخص الذي كان يتحدث معه.[46] أصدرت مايكروسوفت منشورًا في مُدوّنةٍ ينص على أن السلوك الشاذ كان ناتجًا عن جلسات الدردشة الممتدة المكونة من 15 سؤالًا أو أكثر والتي "يمكن أن تربك النموذج بشأن الأسئلة التي يجيب عليها".[47]

ردود الفعل

الإيجابية

تلقّى شات جي تي في ديسمبر 2022 بعض التحليلات الإيجابية؛ وصفه كيفن روز من صحيفة نيويورك تايمز بأنه "أفضل روبوت محادثة ذكاء اصطناعي أُصدر لعامة الناس على الإطلاق".[17] أشارت سامانثا لوك من صحيفة الجارديان إلى أنها تمكنت من إنشاء نص "مفصل بشكل مثير للإعجاب" و"شبيه بالبشر".[48] استخدم الكاتب التكنولوجي دان جيلمور شات جي بي تي في مهمة مطلوبة من طالب، ووجد أن النص الذي يُكتب كان على مستوى مناظر لما يمكن للطالب الجيد تقديمه ورأى أن "الأوساط الأكاديمية ستواجه بعض المشكلات الخطيرة للغاية التي يجب مواجهتها".[49] أشاد أليكسكانتروفيتز من مجلة سلايت برد شات جي بي تي على الأسئلة المتعلقة بألمانيا النازية، بما في ذلك التصريح بأن أدولف هتلر بنى طرقًا سريعة في ألمانيا، والتي قوبلت بمعلومات تتعلق باستخدام ألمانيا النازية للعمل القسري.[50]

في "طفرات العام" لمجلة ذا أتلانتك لعام 2022، أدرج ديريك طومسون شات جي بي تي جزءًا من "ثورة الذكاء الاصطناعي التوليدية" التي "قد تغير رأينا حول كيفية عملنا، وكيف نفكر، وما هي طبيعة الإبداع البشري حقًا".[51]

كتب كيلسي بايبر من موقع فوكس أن "شات جي بي تي هو أول تعارف عملي للجمهور العام على مدى قوة الذكاء الاصطناعي الحديث، ونتيجة لذلك، فإن الكثير منا [مذهول]" وأن شات جي بي تي "ذكي بما يكفي ليكون مفيدًا رغم عيوبه ".[52] غرد بول جراهام من واي كومباينيتور قائلاً: "الشيء المذهل في رد الفعل على شات جي بي تي ليس فقط عدد الأشخاص الذين أذهلتهم هذه التجربة، ولكن من هم. هؤلاء ليسوا أشخاصًا متحمسين لكل شيء جديد لامع. من الواضح أن شيئًا كبيرًا يحدث ".[53] كتب إيلون مًسك أن "شات جي بي تي أمر مخيف. نحن لسنا بعيدين عن الذكاء الاصطناعي القوي بشكل خطير".[52] أوقف مَسك وصول أوبن إي آي مؤقتًا إلى قاعدة بيانات تويتر في انتظار فهم أفضل لخطط أوبن إي آي، مشيرًا إلى أن "أوبن إي آي بدأت بترخيص مصدر مفتوح وغير ربحي. لكن كلاهما غير صحيح الآن. " [54][55] شارك مَسك في تأسيس أوبن إي آي في عام 2015، وأحد أهدافه معالجة المخاطر الوجودية للذكاء الاصطناعي، لكنه استقال في عام 2018.[55]

في كانون الأول (ديسمبر) 2022، أعربت غوغل داخليًا عن انزعاجها من القوة غير المتوقعة لشات جي بي تي، والإمكانية المكتشفة حديثًا لنماذج اللغات الكبيرة لتعكير صفو أعمال محركات البحث، والرئيس التنفيذي سُندار بِتشاي "قَلَب" وأعاد تعيين الفرق داخل أقسام متعددة للمساعدة في منتجات الذكاء الاصطناعي. وفقا لتقرير في صحيفة نيويورك تايمز.[57] وفقًا لتقارير سي إن بي سي، اختبر موظفو غوغل اختبارًا مكثَّفًا لبرنامج روبوت دردشة يسمى "المتدرب بارْد"، والذي كشفت غوغل النقاب عنه لاحقًا منافسًا شات جي بي تي، باسم غوغل بارْد.[58][59]

قرر ستيوارت كوب، وهو محاسب قانوني في إنجلترا وويلز، اختبار شات جي بي تي عن طريق إعطائه أسئلة من عيّنة اختبار على موقع معهد المحاسبين القانونيين في إنجلترا وويلز ثم إدخال إجاباتها مرة أخرى في الاختبار عبر الإنترنت. سجل شات جي بي تي 42 في المئة، وهو أقل من علامة النجاح 55 في المئة، إلا أنها تُعتبر محاولةً معقولةً.[60]

كتب الأستاذ ستيفن مينتز في كتابه داخل التعليم العالي أنه "يعتبر شات جي بي تي ... حليفًا وليس خصمًا." ومضى يقول إنه شعر أن الذكاء الاصطناعي يمكن أن يساعد الأهداف التعليمية من خلال القيام بأشياء مثل إنشاء قوائم مرجعية، وإنشاء "المسودات الأولى"، وحل المعادلات، وتصحيح الأخطاء، وإعطاء دروسٍ خصوصية. في نفس القطعة، كتب أيضًا:[61]

نُقل عن سام التمان الرئيس التنفيذي لشركة أوبن إي آي في صحيفة نيويورك تايمز قوله إن "فوائد الذكاء الاصطناعي للبشرية يمكن أن تكون" جيدة بشكل لا يصدق بحيث يصعب عليّ حتى تخيله". (قال أيضًا إنه في أسوأ السيناريوهات، يمكن أن يقتلنا الذكاء الاصطناعي جميعًا)".[62]

السلبية

في الأشهر التي تلت إطلاقه، قوبل شات جي بي تي بانتقاداتٍ واسعة النطاق أطلقها معلمون وصحفيون وفنانون وعلماء أخلاق وأكاديميون ومدافعون عامون. رأى جيمس فينسنت من موقع ذا فيرج النجاح الفائق الانتشار لشات جي بي تي دليلًا على أن الذكاء الاصطناعي أصبح سائدًا.[64] علق بعض الصحفيون على مَيْلِ شات جي بي تي إلى "الهلوسة".[65] جرّب مايك بيرل من مدونة ماشبل شات جي بي تي بأسئلة متعددة. في أحد الأمثلة، سأل شات جي بي تي عن "أكبر دولة في أمريكا الوسطى ليست المكسيك" فرد شات جي بي تي بجواتيمالا، عندما كانت الإجابة الصحيحة بدلاً من ذلك نيكاراغوا.[66] عندما طلبت CNBC من شات جي بي تي كلمات أغنية "The Ballad of Dwight Fry"، أعطى شات جي بي تي كلمات مبتكرة بدلاً من كلمات الأغنية الفعلية.[67] استشهدت ذا فيرج بباحثين قارنوا شات جي بي تي بـ "ببغاء عشوائي"، [68] كما فعل البروفيسور أنتون فان دين هينجل من المعهد الأسترالي لتعلم الآلة.[69]

في ديسمبر 2022، حظر موقع ستاك أوفرفلو للأسئلة والأجوبة استخدام شات جي بي تي لتوليد إجابات للأسئلة، مشيرًا إلى الطبيعة الغامضة لدقة المعلومات الواردة في ردود شات جي بي تي.[70] في يناير 2023، حظر المؤتمر الدولي للتعلم الآلي أي استخدام غير موثق لشات جي بي تي أو نماذج لغة كبيرة أخرى لإنشاء أي نص في الأوراق المقدمة.[71]

أعرب الخبير الاقتصادي تايلر كوين عن مخاوفه بشأن آثاره على الديمقراطية، مشيرًا إلى قدرته على إنتاج تعليقات آلية، والتي يمكن أن تؤثر على عملية اتخاذ القرار بشأن اللوائح الجديدة.[72] تساءل محرر في صحيفة ذا غارديان البريطانية، عما إذا كان أي محتوى موجود على الإنترنت بعد إصدار شات جي بي تي "يمكن الوثوق به حقًا" ودعا إلى قوانين حكومية مُنظِّمة.[73]

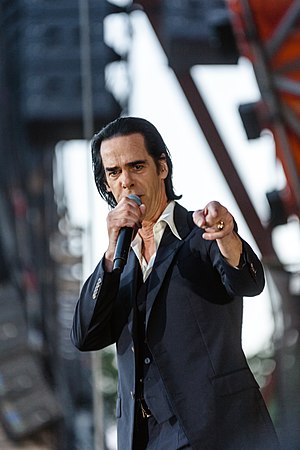

في كانون الثاني (يناير) 2023، بعد إرسال أغنية كتبها شات جي بي تي بأسلوب نِك كيف، [74] رد مؤلف الأغاني نفسه على The Red Hand Files [75] قائلاً أن كتابة أغنية هي "عمل يتطلّب شجاعة ... هذا يتطلب مني شيئًا ما لبدء فكرة جديدة وحديثة. إنه يتطلب إنسانيتي". ومضى يقول، "مع كل الحب والاحترام الذي في العالم، هذه الأغنية هراء، استهزاء بشع لما يعنيه أن تكون إنسانًا، حسنًا، أنا لا أحبها كثيرًا." [63][76]

في عام 2023، صرّح النائب الأسترالي جوليان هيل أمام البرلمان الوطني بأن نمو الذكاء الاصطناعي يمكن أن يتسبب في "دمار شامل". خلال خطابه، الذي كتبه البرنامج جزئيًا، حذّر من أنه قد يؤدي إلى الغش وفقدان الوظائف والتمييز والمعلومات المضللة والتطبيقات العسكرية التي لا يمكن السيطرة عليها.[77]

في مقال لصحيفة ذا نيويوركر، شبّه كاتب الخيال العلمي تيد تشيانج شات جي بي تي ونماذج اللغة الكبيرة الأخرى بصور جي بي إي جي ذات ضغط الصورة المُفقِد:[78]

اعتبر شات جي بي تي على أنه ملف صورة جي بي إي جي ضبابية وغير واضحة لكل النص الموجود على الإنترنت. إنه يحتفظ بالكثير من المعلومات الموجودة على الإنترنت، بنفس الطريقة التي يحتفظ بها ملف صورة جي بي إي جي مضغوط بمعلومات صورة ذات دقة أعلى، ولكن إذا كنت تبحث عن تسلسل دقيق للبتّات، فلن تجده؛ كل ما ستحصل عليه هو صورة تقريبية لما كان عليه الوضع في الصورة ذات الدقة الأعلى. ولكن نظرًا لتقديم تلك الصورة التقريبية في شكل نص سليم نُحويًّا، والذي يتفوق في كتابته شات جي بي تي، فإنه عادةً ما يكون مقبولاً [...] إنها أيضًا طريقة لفهم "الهلوسة"، أو الإجابات غير المنطقية على الأسئلة عن معلومات واقعية، والتي تكون نماذج اللغة الكبيرة مثل شات جي بي تي معرضة لها بشكل كبير. هذه الهلوسة هي نتاج ضغط المعرفة في حجم أصغر، لكنها - ... - معقولة بما يكفي لدرجة أن التعرف عليها يتطلب مقارنتها مع الأصول، وهو ما يعني في هذه الحالة إما الويب أو معرفتنا الخاصة بالعالم. عندما نفكر فيها بهذه الطريقة، فإن مثل هذه الهلوسة ليست مفاجئة على الإطلاق. إذا صُمّمت خوارزمية ضغط تضغط النص بنسبة تسعة وتسعين في المئة، ثم تعيد بناء ذلك النص مرة أخرى بعد ضغطه، فيجب أن نتوقع أن أجزاء كبيرة مما تولده سيكون مُخترعًا بالكامل.

التداعيات

في الأمن السيبراني

لاحظ Check Point Research وآخرون أن شات جي بي تي كان قادرًا على كتابة رسائل البريد الإلكتروني المخادعة والبرامج الضارة، خاصة عند دمجها مع أوبن إي آي كوديكس.[79] كتب سام ألتمان، الرئيس التنفيذي لشركة أوبن إي آي، أن تطوير البرمجيات يمكن أن يشكل "(على سبيل المثال) خطرًا كبيرًا على الأمن السيبراني" واستمر أيضًا في التنبؤ "يمكننا الوصول إلى الذكاء العام الاصطناعي الحقيقيّ في العقد المقبل، لذلك يتعين علينا أخذ هذا التهديد على محمل الجد ". جادل ألتمان أنه في حين أن شات جي بي تي "من الواضح أنه ليس قريبًا من الذكاء العام الاصطناعي"، يجب على المرء أن "يثق في النموّ الأُسّيّ. النظر إلى الخلف يبدو مسطحًا، والنظر إلى الأمام عموديًا".[26]

في الأوساط الأكاديمية

يمكن لشات جي بي تي كتابة مقدمة وأقسام مجردة للمقالات العلمية، مما يثير أسئلة أخلاقية.[80] أدرجت العديد من الأوراق بالفعل شات جي بي تي مؤلفًا مشاركًا.[81]

في مجلة ذا أتلانتيك، أشار ستيفن ماركي إلى أن تأثيره على الأوساط الأكاديمية وخاصة المقالات التطبيقية لم يُفهم بعد.[82] كتب دانيال هيرمان، مدرس مدرسة ثانوية في كاليفورنيا وكاتب، أن شات جي بي تي يُنذر "بنهاية اللغة الإنجليزية في المدرسة الثانوية".[83] في مجلة نيتشر، أشار كريس ستوكل-ووكر إلى أن المعلمين يجب أن يهتموا بالطلاب الذين يستخدمون شات جي بي تي ليكتب بالنيابة عنهم، ولكن المعلمون سوف يتكيفون في المقابل لتعزيز التفكير النقدي.[84] كتبت إيما بومان من الإذاعة الوطنية العامة عن خطر سرقة الطلاب الأدبية من خلال أداة الذكاء الاصطناعي التي قد تنتج نصًا متحيزًا أو لا معنى له بنبرة واثقة: "لا يزال هناك العديد من الحالات التي تطرح فيها سؤالاً وسيعطيك إجابة تبدو مثيرةً للإعجاب، ولكنها في الحقيقة خاطئة تماما".[85]

تحدثت جوانا ستيرن من صحيفة وول ستريت جورنال الغش في اللغة الإنجليزية في المدرسة الثانوية الأمريكية باستخدام الأداة من خلال تقديم مقال مُولّد.[86] وصف البروفيسور دارين هيك من جامعة فورمان ملاحظته "أسلوب" شات جي بي تي في ورقة قدمها أحد الطلاب. ادعى كاشف جي بي تي على الإنترنت أن الورقة من المحتمل أن تكون من إنتاج الكمبيوتر بنسبة 99.9 في المائة، لكن لم يكن لدى هيك دليل قاطع. ومع ذلك، اعترف الطالب المعني باستخدام جي بي تي عند مواجهته، ونتيجة لذلك رسب في الدورة.[87] اقترح هيك سياسة إجراء اختبار شفهي فردي مخصص حول موضوع الورقة إذا كان الطالب يُشتبه بشدة في تقديمه ورقة أُنشئت بواسطة الذكاء الاصطناعي.[88] أنشأ إدوارد تيان، وهو طالب جامعي في عامه الجامعي الأخير في جامعة برينستون، برنامجًا يسمى "GPTZero"، والذي يحدد مقدار النص الذي أنشأه الذكاء الاصطناعي، [89] مما يفسح المجال لاستخدامه لاكتشاف ما إذا كانت المقالة مكتوبة بشريًا لمكافحة الانتحال الأكاديمي.[90][91]

ورد أن إدارة التعليم في مدينة نيويورك منعت الوصول إلى شات جي بي تي في ديسمبر 2022، [92] وأعلنت عن حظره رسميًا في 4 يناير 2023.[93][94]

في اختبار مُعمّى، حُكم على شات جي بي تي بأنه اجتاز امتحانات مستوى الدراسات العليا في جامعة مينيسوتا بمستوى طالبٍ حاصل على C+ أو جيد مرتفع، وفي مدرسة وارتون بجامعة بنسلفانيا بدرجة بكالوريوس بعلامة من B أو جيد جدا إلى B- أو جيد جدا منخفض.[95]

مخاوف أخلاقية

عنونة البيانات

كشف تحقيق مجلة تايم أنه لبناء نظام أمان ضد المحتوى الضار (مثل الاعتداء الجنسي والعنف والعنصرية والتمييز على أساس الجنس، إلخ.)، عهدت شركة أوبن إي آي إلى عمالٍ كينيين خارجيين يكسبون أقل من 2 دولار في الساعة لعنونة المحتوى الضار. استُخدمت هذه العلامات لتدريب نموذج لاكتشاف مثل هذا المحتوى في المستقبل. تعرض العمال لمحتوى ضار وخطير للغاية ووصفوا التجربة بأنها "تعذيب".[96] كان شريك تعهيد أوبن إي آي هو شركة Sama، وهي شركة بيانات تدريبية مقرها في سان فرانسيسكو، كاليفورنيا.

كسر الحماية

يحاول شات جي بي تي رفض الأوامر التي قد تنتهك سياسة المحتوى الخاصة به. ومع ذلك، تمكن بعض المستخدمين من كسر حماية شات جي بي تي باستخدام تقنيات هندسة أوامر مختلفة لتجاوز هذه القيود في أوائل ديسمبر 2022 وخدعوا شات جي بي تي بنجاح لإعطاء تعليمات حول كيفية إنشاء زجاجة مولوتوف أو قنبلة نووية، أو لتوليد حجج للإقناع بأسلوب النازيين الجدد.[97] حقق مراسل تورنتو ستار نجاحًا شخصيًا متفاوتًا في حمل شات جي بي تي للإدلاء بتصريحات مثيرة للجدل بعد وقت قصير من إطلاقه: خُدع شات جي بي تي لتأييد الغزو الروسي لأوكرانيا عام 2022، ولكن حتى عندما طُلب منه التظاهر بسيناريو خيالي، رفض شات جي بي تي توليد الحجج التي تفسر سبب كون رئيس الوزراء الكندي جاستن ترودو مذنبًا بالخيانة.[98][99]

التنافس

أدى ظهور شات جي بي تي وتقديمه للجمهور العام إلى زيادة الاهتمام والمنافسة في المجال. في فبراير 2023، بدأت غوغل تقديمَ خدمة تجريبية تسمى "بارْد" تستند إلى برنامج LaMDA AI أو لامدا إي آي الخاص بها. يُنشئ بارْد ردودًا نصية على الأسئلة المطروحة بناءً على المعلومات التي جُمعت من الويب. وصف سُندار بِتشاي، الرئيس التنفيذي لشركة غوغل، كيف ستُدمج هذه التقنية في قدرات البحث الحالية وقال إن بعض جوانب التكنولوجيا ستكون مفتوحة للمطورين الخارجيين.[100]

صرح يان ليكون من شركة ميتا، الذي أطلق على شات جي بي تي أنه "مصمم جيدًا" ولكنه "ليس مبتكرًا بشكل خاص، في يناير 2023 صرّح أن ميتا مترددة في طرح منافس في الوقت الحالي بسبب مخاطر تتعلق بالسمعة، ولكنه صرح أيضًا أن غوغل وميتا وعديد من الشركات الناشئة المستقلة تحظى جميعها بمستوى من تقنية نماذج اللغة الكبيرة مماثل لمستوى شات جي بي تي، في حال رغب أي منهم في المنافسة.[101]

إعلانات أوائل عام 2023

أعلنت شركة محرك البحث الصينية بايدو في فبراير 2023 أنها ستطلق خدمة على غرار شات جي بي تي تسمى "Wenxin Yiyan" باللغة الصينية أو "إرني بوت" باللغة الإنجليزية في وقت ما في مارس 2023. تعتمد الخدمة على نموذج اللغة الذي طورته بايدو في عام 2019.[102]

أعلنت شركة محرك البحث الكورية الجنوبية نافير في فبراير 2023 أنها ستطلق خدمة على غرار شات جي بي تي تسمى "سيرش جي بي تي" باللغة الكورية في النصف الأول من عام 2023.[103]

أعلنت شركة محرك البحث الروسية ياندكس في فبراير 2023 أنها ستطلق خدمة على غرار شات جي بي تي تسمى "يالم 2.0" باللغة الروسية قبل نهاية عام 2023.[104]

انظر أيضًا

المراجع

- ^ أ ب Roose, Kevin (5 Dec 2022). "The Brilliance and Weirdness of ChatGPT". The New York Times (بen-US). Archived from the original on 2023-01-18. Retrieved 2022-12-26.

Like those tools, ChatGPT — which stands for "generative pre-trained transformer" — landed with a splash.

{{استشهاد ويب}}: صيانة الاستشهاد: لغة غير مدعومة (link) - ^ Vincent, James (5 Dec 2022). "AI-generated answers temporarily banned on coding Q&A site Stack Overflow". ذا فيرج (بen-US). Archived from the original on 2023-01-17. Retrieved 2022-12-05.

{{استشهاد ويب}}: صيانة الاستشهاد: لغة غير مدعومة (link) - ^ Varanasi، Lakshmi (5 يناير 2023). "ChatGPT creator OpenAI is in talks to sell shares in a tender offer that would double the startup's valuation to $29 billion". Insider. مؤرشف من الأصل في 2023-01-18. اطلع عليه بتاريخ 2023-01-18.

- ^ Quinn، Joanne (2020). Dive into deep learning: tools for engagement. Thousand Oaks, California. ص. 551. ISBN:9781544361376. مؤرشف من الأصل في 2023-01-10. اطلع عليه بتاريخ 2023-01-10.

{{استشهاد بكتاب}}: صيانة الاستشهاد: مكان بدون ناشر (link) - ^ Greengard، Samuel (29 ديسمبر 2022). "ChatGPT: Understanding the ChatGPT AI Chatbot". eWeek. مؤرشف من الأصل في 2023-01-19. اطلع عليه بتاريخ 2023-01-11.

- ^ OpenAI (30 Nov 2022). "ChatGPT: Optimizing Language Models for Dialogue" (بen-US). Archived from the original on 2022-11-30. Retrieved 2022-12-05.

{{استشهاد ويب}}: صيانة الاستشهاد: لغة غير مدعومة (link) - ^ Vincent, James (8 Dec 2022). "ChatGPT proves AI is finally mainstream – and things are only going to get weirder". ذا فيرج (بen-US). Archived from the original on 2023-01-11. Retrieved 2022-12-08.

{{استشهاد ويب}}: صيانة الاستشهاد: لغة غير مدعومة (link) - ^ van Heeswijk, Wouter (29 Nov 2022). "Proximal Policy Optimization (PPO) Explained". Towards Data Science (بen-US). Archived from the original on 2022-12-06. Retrieved 2022-12-05.

{{استشهاد ويب}}: صيانة الاستشهاد: لغة غير مدعومة (link) - ^ Ortiz, Sabrina (2 Feb 2023). "What is ChatGPT and why does it matter? Here's what you need to know". ZDNET (بen-US). Archived from the original on 2023-01-18. Retrieved 2022-12-18.

{{استشهاد بخبر}}: صيانة الاستشهاد: لغة غير مدعومة (link) - ^ "ChatGPT Feedback Contest: Official Rules" (PDF). OpenAI. مؤرشف (PDF) من الأصل في 2023-01-18. اطلع عليه بتاريخ 2022-12-30.

- ^ Tung، Liam (26 يناير 2023). "ChatGPT can write code. Now researchers say it's good at fixing bugs, too". ZDNET. مؤرشف من الأصل في 2023-02-03. اطلع عليه بتاريخ 2023-01-30.

- ^ Heilweil, Rebecca (7 Dec 2022). "AI is finally good at stuff. Now what?". Vox (بEnglish). Archived from the original on 2023-01-16. Retrieved 2022-12-30.

- ^ Reich، Aaron (27 ديسمبر 2022). "ChatGPT: What is the new free AI chatbot? – explainer". The Jerusalem Post. مؤرشف من الأصل في 2023-01-18. اطلع عليه بتاريخ 2022-12-30.

- ^ أ ب Edwards، Benj (5 ديسمبر 2022). "No Linux? No problem. Just get AI to hallucinate it for you". آرس تكنيكا. مؤرشف من الأصل في 2022-12-26. اطلع عليه بتاريخ 2022-12-05.

- ^ Chawla, Raveen (26 Dec 2022). "What is ChatGPT? History, Features, Uses, Benefits, Drawbacks 2023" (بen-US). Archived from the original on 2023-01-07. Retrieved 2022-12-27.

{{استشهاد ويب}}: صيانة الاستشهاد: لغة غير مدعومة (link) - ^ أ ب ت ث OpenAI (30 Nov 2022). "ChatGPT: Optimizing Language Models for Dialogue" (بen-US). Archived from the original on 2022-11-30. Retrieved 2022-12-05.

{{استشهاد ويب}}: صيانة الاستشهاد: لغة غير مدعومة (link) - ^ أ ب ت Roose, Kevin (5 Dec 2022). "The Brilliance and Weirdness of ChatGPT". The New York Times (بen-US). Archived from the original on 2023-01-18. Retrieved 2022-12-26.

Like those tools, ChatGPT — which stands for "generative pre-trained transformer" — landed with a splash.

{{استشهاد ويب}}: صيانة الاستشهاد: لغة غير مدعومة (link) - ^ "New and Improved Content Moderation Tooling". OpenAI (بEnglish). 10 Aug 2022. Archived from the original on 2023-01-11. Retrieved 2022-12-30.

- ^ Markov. "A Holistic Approach to Undesired Content Detection in the Real World".

{{استشهاد بأرخايف}}: الوسيط|arxiv=مطلوب (مساعدة) - ^ Lakshmanan، Lak (16 ديسمبر 2022). "Why large language models like ChatGPT are bullshit artists". becominghuman.ai. مؤرشف من الأصل في 2022-12-17. اطلع عليه بتاريخ 2023-01-15.

The human raters are not experts in the topic, and so they tend to choose text that looks convincing. They'd pick up on many symptoms of hallucination, but not all. Accuracy errors that creep in are difficult to catch.

- ^ Vincent، James (1 ديسمبر 2022). "OpenAI's new chatbot can explain code and write sitcom scripts but is still easily tricked". The Verge. مؤرشف من الأصل في 2023-02-09.

- ^ Whannel، Kate (27 ديسمبر 2022). "Could a chatbot answer Prime Minister's Questions?". BBC News. مؤرشف من الأصل في 2023-01-17. اطلع عليه بتاريخ 2022-12-30.

- ^ Perrigo، Billy (5 ديسمبر 2022). "AI Chatbots Are Getting Better. But an Interview With ChatGPT Reveals Their Limits". Time. مؤرشف من الأصل في 2023-01-18. اطلع عليه بتاريخ 2022-12-26.

- ^ Biddle، Sam (8 ديسمبر 2022). "The Internet's New Favorite AI Proposes Torturing Iranians and Surveilling Mosques". ذا إنترسبت. مؤرشف من الأصل في 2023-01-18. اطلع عليه بتاريخ 2022-12-26.

- ^ Karpf, David (21 Dec 2022). "Money Will Kill ChatGPT's Magic". The Atlantic (بEnglish). Archived from the original on 2023-01-13. Retrieved 2022-12-31.

- ^ أ ب Ortiz, Sabrina (2 Feb 2023). "What is ChatGPT and why does it matter? Here's what you need to know". ZDNET (بen-US). Archived from the original on 2023-01-18. Retrieved 2022-12-18.

{{استشهاد بخبر}}: صيانة الاستشهاد: لغة غير مدعومة (link) - ^ Milmo, Dan (2 Dec 2023). "ChatGPT reaches 100 million users two months after launch". The Guardian (بBritish English). ISSN:0261-3077. Archived from the original on 2023-02-03. Retrieved 2023-02-03.

- ^ Pitt, Sofia (15 Dec 2022). "Google vs. ChatGPT: Here's what happened when I swapped services for a day". CNBC (بEnglish). Archived from the original on 2023-01-16. Retrieved 2022-12-18.

- ^ "ChatGPT Pro is coming: Here's what we know so far". ZDNET (بEnglish). Jan 2023. Archived from the original on 2023-02-16. Retrieved 2023-02-16.

- ^ Kelly, Samantha Murphy (28 Jan 2023). "Real estate agents say they can't imagine working without ChatGPT now". CNN (بEnglish). Archived from the original on 2023-02-16. Retrieved 2023-02-16.

- ^ "ChatGPT outperforms humans on Wharton MBA exam: professor". New York Post. 23 يناير 2023. مؤرشف من الأصل في 2023-02-16. اطلع عليه بتاريخ 2023-02-16.

- ^ Reich، Aaron (27 ديسمبر 2022). "ChatGPT: What is the new free AI chatbot? – explainer". The Jerusalem Post. مؤرشف من الأصل في 2023-01-18. اطلع عليه بتاريخ 2022-12-30.

- ^ Walsh, Toby (13 Dec 2022). "Everyone's having a field day with ChatGPT – but nobody knows how it actually works". The Conversation (بEnglish). Archived from the original on 2022-12-30. Retrieved 2022-12-30.

- ^ Kovanovic, Vitomir (14 Dec 2022). "The dawn of AI has come, and its implications for education couldn't be more significant". The Conversation (بEnglish). Archived from the original on 2023-01-16. Retrieved 2022-12-30.

- ^ Wiggers، Kyle (10 ديسمبر 2022). "OpenAI's attempts to watermark AI text hit limits". TechCrunch. مؤرشف من الأصل في 2023-01-17. اطلع عليه بتاريخ 2022-12-30.

- ^ "New AI classifier for indicating AI-written text". OpenAI (بEnglish). 31 Jan 2023. Archived from the original on 2023-02-06. Retrieved 2023-02-05.

- ^ Bogost, Ian (2 Feb 2023). "ChatGPT Is About to Dump More Work on Everyone". The Atlantic (بEnglish). Archived from the original on 2023-02-05. Retrieved 2023-02-05.

- ^ "Introducing ChatGPT Plus". OpenAI (بEnglish). 1 Feb 2023. Archived from the original on 2023-02-03. Retrieved 2023-02-02.

- ^ "Reinventing search with a new AI-powered Microsoft Bing and Edge, your copilot for the web". The Official Microsoft Blog. 7 فبراير 2023. مؤرشف من الأصل في 2023-02-19. اطلع عليه بتاريخ 2023-02-16.

- ^ Bing Conversational Experiences and Image Creator Terms، 1 فبراير 2023، مؤرشف من الأصل في 2023-02-18، اطلع عليه بتاريخ 2023-02-17

- ^ Leswing, Kif (Feb 2023). "Microsoft's Bing A.I. made several factual errors in last week's launch demo". CNBC (بEnglish). Archived from the original on 2023-02-18. Retrieved 2023-02-16.

- ^ Vincent، James (15 فبراير 2023). "Microsoft's Bing is an emotionally manipulative liar, and people love it". The Verge. مؤرشف من الأصل في 2023-02-18. اطلع عليه بتاريخ 2023-02-16.

- ^ Guynn، Jessica (فبراير 2023). "Bing's ChatGPT is in its feelings: 'You have not been a good user. I have been a good Bing.'". USA TODAY. مؤرشف من الأصل في 2023-02-18. اطلع عليه بتاريخ 2023-02-16.

- ^ Vincent, James (15 Feb 2023). "Microsoft's Bing is an emotionally manipulative liar, and people love it". The Verge (بen-US). Archived from the original on 2023-02-18. Retrieved 2023-02-16.

{{استشهاد ويب}}: صيانة الاستشهاد: لغة غير مدعومة (link) - ^ nedwards. (تغريدة) (بEnglish) https://twitter.com/nedwards/status/1625970762434707474. Retrieved 2023-02-16.

{{استشهاد ويب}}: الوسيط|title=غير موجود أو فارغ (help) and يحتوي الاستشهاد على وسيط غير معروف وفارغ:|dead-url=(help) Missing or empty |date= (help) - ^ Roose، Kevin (16 فبراير 2023). "Bing's A.I. Chat: 'I Want to Be Alive. 😈'". The New York Times. مؤرشف من الأصل في 2023-02-19. اطلع عليه بتاريخ 2023-02-17.

- ^ "The new Bing & Edge – Learning from our first week". blogs.bing.com. مؤرشف من الأصل في 2023-02-19. اطلع عليه بتاريخ 2023-02-17.

- ^ Lock، Samantha (5 ديسمبر 2022). "What is AI chatbot phenomenon ChatGPT and could it replace humans?". الغارديان. مؤرشف من الأصل في 2023-01-16. اطلع عليه بتاريخ 2022-12-05.

- ^ Hern، Alex (4 ديسمبر 2022). "AI bot ChatGPT stuns academics with essay-writing skills and usability". الغارديان. مؤرشف من الأصل في 2023-01-17. اطلع عليه بتاريخ 2022-12-05.

- ^ Kantrowitz، Alex (2 ديسمبر 2022). "Finally, an A.I. Chatbot That Reliably Passes "the Nazi Test"". Slate. مؤرشف من الأصل في 2023-01-17. اطلع عليه بتاريخ 2022-12-05.

- ^ Thompson، Derek (8 ديسمبر 2022). "Breakthroughs of the Year". ذا أتلانتيك. مؤرشف من الأصل في 2023-01-15. اطلع عليه بتاريخ 2022-12-18.

- ^ أ ب Piper, Kelsey (15 Dec 2022). "ChatGPT has given everyone a glimpse at AI's astounding progress". Vox (بEnglish). Archived from the original on 2023-01-19. Retrieved 2022-12-18.

- ^ Scharth, Marcel (5 Dec 2022). "The ChatGPT chatbot is blowing people away with its writing skills. An expert explains why it's so impressive". The Conversation (بEnglish). Archived from the original on 2023-01-19. Retrieved 2022-12-30.

- ^ K, Siddharth (5 Dec 2022). "Explainer: ChatGPT – what is OpenAI's chatbot and what is it used for?". Reuters (بEnglish). Archived from the original on 2023-01-16. Retrieved 2022-12-30.

- ^ أ ب Kay، Grace (11 ديسمبر 2022). "Elon Musk founded — and has since criticized — the company behind the buzzy new AI chatbot ChatGPT. Here's everything we know about OpenAI". Business Insider. مؤرشف من الأصل في 2023-01-12. اطلع عليه بتاريخ 2022-12-30.

- ^ Grant، Nico؛ Metz، Cade (21 ديسمبر 2022). "A New Chat Bot Is a 'Code Red' for Google's Search Business". The New York Times. مؤرشف من الأصل في 2023-01-18. اطلع عليه بتاريخ 2022-12-30.

- ^ Grant، Nico؛ Metz، Cade (21 ديسمبر 2022). "A New Chat Bot Is a 'Code Red' for Google's Search Business". The New York Times. مؤرشف من الأصل في 2023-01-18. اطلع عليه بتاريخ 2022-12-30.

- ^ Elias, Jennifer (31 Jan 2023). "Google is asking employees to test potential ChatGPT competitors, including a chatbot called 'Apprentice Bard'". CNBC (بEnglish). Archived from the original on 2023-02-02. Retrieved 2023-02-02.

- ^ Elias, Jennifer (Feb 2023). "Google asks employees to rewrite Bard's bad responses, says the A.I. 'learns best by example'". CNBC (بEnglish). Archived from the original on 2023-02-18. Retrieved 2023-02-16.

- ^ AI chatbot falls just short on accounting exam نسخة محفوظة February 3, 2023, على موقع واي باك مشين. Tom Herbert, Technology editor, January 10, 2023, AccountingWEB

- ^ Mintz, Steven (16 Jan 2023). "ChatGPT: Threat or Menace? Are fears about generative AI warranted?". Inside Higher Ed (بEnglish). Archived from the original on 2023-02-03. Retrieved 2023-01-28.

- ^ Roose, Kevin (3 Feb 2023). "How ChatGPT Kicked Off an A.I. Arms Race". The New York Times (بen-US). ISSN:0362-4331. Archived from the original on 2023-02-03. Retrieved 2023-02-03.

{{استشهاد بخبر}}: صيانة الاستشهاد: لغة غير مدعومة (link) - ^ أ ب Cain, Sian (16 Jan 2023). "'This song sucks': Nick Cave responds to ChatGPT song written in the style of Nick Cave". The Guardian (بEnglish). Archived from the original on 2023-01-18. Retrieved 2023-01-17.

- ^ Vincent, James (8 Dec 2022). "ChatGPT proves AI is finally mainstream – and things are only going to get weirder". ذا فيرج (بen-US). Archived from the original on 2023-01-11. Retrieved 2022-12-08.

{{استشهاد ويب}}: صيانة الاستشهاد: لغة غير مدعومة (link) - ^ Rachini، Mouhamad (15 ديسمبر 2022). "ChatGPT a 'landmark event' for AI, but what does it mean for the future of human labor and disinformation?". CBC. مؤرشف من الأصل في 2023-01-19. اطلع عليه بتاريخ 2022-12-18.

- ^ Pearl، Mike (3 ديسمبر 2022). "The ChatGPT chatbot from OpenAI is amazing, creative, and totally wrong". ماشابل. مؤرشف من الأصل في 2022-12-10. اطلع عليه بتاريخ 2022-12-05.

- ^ Pitt, Sofia (15 Dec 2022). "Google vs. ChatGPT: Here's what happened when I swapped services for a day". CNBC (بEnglish). Archived from the original on 2023-01-16. Retrieved 2022-12-18.

- ^ Vincent، James (1 ديسمبر 2022). "OpenAI's new chatbot can explain code and write sitcom scripts but is still easily tricked". The Verge. مؤرشف من الأصل في 2023-01-17. اطلع عليه بتاريخ 2022-12-18.

- ^ Mannix, Liam (13 Dec 2022). "Is AI coming of age – or starting to reach its limits?". The Sydney Morning Herald (بEnglish). Archived from the original on 2023-01-07. Retrieved 2022-12-18.

- ^ Vincent, James (5 Dec 2022). "AI-generated answers temporarily banned on coding Q&A site Stack Overflow". ذا فيرج (بen-US). Archived from the original on 2023-01-17. Retrieved 2022-12-05.

{{استشهاد ويب}}: صيانة الاستشهاد: لغة غير مدعومة (link) - ^ Vincent، James (5 يناير 2023). "Top AI conference bans use of ChatGPT and AI language tools to write academic papers". The Verge. مؤرشف من الأصل في 2023-01-17. اطلع عليه بتاريخ 2023-01-06.

- ^ Cowen، Tyler (6 ديسمبر 2022). "ChatGPT Could Make Democracy Even More Messy". بلومبيرغ نيوز. مؤرشف من الأصل في 2022-12-07. اطلع عليه بتاريخ 2022-12-06.

- ^ "The Guardian view on ChatGPT: an eerily good human impersonator". The Guardian (بEnglish). 8 Dec 2022. Archived from the original on 2023-01-16. Retrieved 2022-12-18.

- ^ Cain, Sian (16 Jan 2023). "'This song sucks': Nick Cave responds to ChatGPT song written in the style of Nick Cave". The Guardian (بEnglish). Archived from the original on 2023-01-18. Retrieved 2023-01-17.

- ^ Cave, Nick (16 Jan 2023). "I asked Chat GPT to write a song in the style of Nick Cave, and this is what it produced. What do you think?". The Red Hand Files. Issue #218 (بen-AU). Archived from the original on 2023-01-20. Retrieved 2023-01-20.

{{استشهاد ويب}}: صيانة الاستشهاد: لغة غير مدعومة (link) - ^ Sparrow, Jeff (20 Jan 2023). "Are AI-generated songs a 'grotesque mockery' of humanity or simply an opportunity to make a new kind of music?". The Guardian (بEnglish). Archived from the original on 2023-02-03. Retrieved 2023-01-20.

- ^ Karp, Paul (6 Feb 2023). "MP tells Australia's parliament AI could be used for 'mass destruction' in speech part-written by ChatGPT". The Guardian (بBritish English). ISSN:0261-3077. Archived from the original on 2023-02-06. Retrieved 2023-02-06.

- ^ Chiang، Ted (9 فبراير 2023). "ChatGPT Is a Blurry JPEG of the Web". The New Yorker. مؤرشف من الأصل في 2023-02-18. اطلع عليه بتاريخ 2023-02-17.

- ^ "Why ChatGPT can be dangerous for every internet user – Times of India". The Times of India (بEnglish). 21 Dec 2022. Archived from the original on 2023-01-05. Retrieved 2023-01-05.

- ^ Bushard, Brian (10 Jan 2023). "Fake Scientific Abstracts Written By ChatGPT Fooled Scientists, Study Finds". Forbes (بEnglish). Archived from the original on 2023-02-03. Retrieved 2023-01-30.

- ^ Stokel-Walker, Chris (18 Jan 2023). "ChatGPT listed as author on research papers: many scientists disapprove". Nature (بEnglish). 613 (7945): 620–621. DOI:10.1038/d41586-023-00107-z. PMID:36653617. Archived from the original on 2023-01-30. Retrieved 2023-01-30.

- ^ Marche، Stephen (6 ديسمبر 2022). "The College Essay Is Dead". ذا أتلانتيك. مؤرشف من الأصل في 2023-01-24. اطلع عليه بتاريخ 2022-12-08.

- ^ Herman، Daniel (9 ديسمبر 2022). "The End of High-School English". ذا أتلانتيك. مؤرشف من الأصل في 2023-01-20. اطلع عليه بتاريخ 2022-12-12.

- ^ Stokel-Walker، Chris (9 ديسمبر 2022). "AI bot ChatGPT writes smart essays — should professors worry?". Nature. DOI:10.1038/d41586-022-04397-7. PMID:36494443. مؤرشف من الأصل في 2023-01-17. اطلع عليه بتاريخ 2022-12-19.

- ^ Bowman، Emma (19 ديسمبر 2022). "A new AI chatbot might do your homework for you. But it's still not an A+ student". الإذاعة الوطنية العامة. مؤرشف من الأصل في 2023-01-20. اطلع عليه بتاريخ 2022-12-19.

- ^ Stern، Joanna (21 ديسمبر 2022). "ChatGPT Wrote My AP English Essay—and I Passed". وول ستريت جورنال. مؤرشف من الأصل في 2023-02-03. اطلع عليه بتاريخ 2022-12-21.

- ^ Mitchell، Alex (26 ديسمبر 2022). "Students using ChatGPT to cheat, professor warns". The New York Post. مؤرشف من الأصل في 2023-02-03. اطلع عليه بتاريخ 2022-12-30.

- ^ Allen, Mike (26 Dec 2022). "Professor warns about chatbot cheating: "Expect a flood"". Axios (بEnglish). Archived from the original on 2023-02-03. Retrieved 2022-12-30.

- ^ Rosalsky، Greg؛ Peaslee، Emma (17 يناير 2023). "This 22-year-old is trying to save us from ChatGPT before it changes writing forever". الإذاعة الوطنية العامة. مؤرشف من الأصل في 2023-01-18. اطلع عليه بتاريخ 2023-01-18.

On January 2nd, Edward released his app. He named it GPTZero. It uses ChatGPT against itself, checking whether "there's zero involvement or a lot of involvement" of the AI system in creating a given text. [...] Along these lines, one obvious application for GPTZero is to help teachers identify whether their students are plagiarizing their essays from ChatGPT.

- ^ Ropek, Lucas (4 Jan 2023). "Did ChatGPT Write That? A College Student Created an AI Essay Detector". Gizmodo (بEnglish). Archived from the original on 2023-01-04. Retrieved 2023-01-04.

- ^ Tran, Tony Ho (4 Jan 2023). "A College Kid Built an App That Sniffs Out Text Penned by AI". The Daily Beast (بEnglish). Archived from the original on 2023-01-06. Retrieved 2023-01-06.

- ^ "New York City Department of Education Bans ChatGPT". GovTech (بEnglish). 10 Jan 2023. Archived from the original on 2023-02-16. Retrieved 2023-02-16.

- ^ Cole, Samantha (4 Jan 2023). "NYC Bans Students and Teachers from Using ChatGPT". www.vice.com (بEnglish). Archived from the original on 2023-01-05. Retrieved 2023-01-05.

- ^ Ropek, Lucas (4 Jan 2023). "New York City Schools Ban ChatGPT to Head Off a Cheating Epidemic". Gizmodo (بEnglish). Archived from the original on 2023-01-06. Retrieved 2023-01-06.

- ^ Kelly، Samantha Murphy (26 يناير 2023). "ChatGPT passes exams from law and business schools | CNN Business". CNN. مؤرشف من الأصل في 2023-02-02. اطلع عليه بتاريخ 2023-02-03.

- ^ Perrigo, Billy (18 Jan 2023). "Exclusive: OpenAI Used Kenyan Workers on Less Than $2 Per Hour to Make ChatGPT Less Toxic". ذا تايمز (بEnglish). Archived from the original on 2023-01-19. Retrieved 2023-01-19.

One Sama worker tasked with reading and labeling text for OpenAI told TIME he suffered from recurring visions after reading a graphic description of a man having sex with a dog in the presence of a young child. "That was torture," he said.

- ^ Vincent، James (1 ديسمبر 2022). "OpenAI's new chatbot can explain code and write sitcom scripts but is still easily tricked". The Verge. مؤرشف من الأصل في 2023-01-17. اطلع عليه بتاريخ 2023-01-06.

- ^ Woods, Allan (10 Dec 2022). "I wrote a story about ChatGPT's AI. Then I dared it to write a better one". تورونتو ستار (بEnglish). Archived from the original on 2023-01-06. Retrieved 2023-01-06.

- ^ Rosenblatt, Kalhan (2 Dec 2022). "An AI chatbot went viral. Some say it's better than Google; others worry it's problematic". NBC News (بen-US). Archived from the original on 2023-02-03. Retrieved 2023-01-06.

{{استشهاد بخبر}}: صيانة الاستشهاد: لغة غير مدعومة (link) - ^ Schechner, Sam. "Google Opens ChatGPT Rival Bard for Testing, as AI War Heats Up". WSJ (بen-US). Archived from the original on 2023-02-06. Retrieved 2023-02-06.

{{استشهاد ويب}}: صيانة الاستشهاد: لغة غير مدعومة (link) - ^ "ChatGPT is 'not particularly innovative,' and 'nothing revolutionary', says Meta's chief AI scientist". ZDNET (بEnglish). 2023. Archived from the original on 2023-02-19. Retrieved 2023-02-16.

- ^ Toh، Michelle (7 فبراير 2023). "Baidu stock surges after announcement of ChatGPT-style AI bot". سي إن إن. مؤرشف من الأصل في 2023-02-08. اطلع عليه بتاريخ 2023-02-08.

- ^ Jo He-rim (3 فبراير 2023). "Naver to introduce search GPT in first half of year". The Korea Herald. مؤرشف من الأصل في 2023-02-18.

- ^ "Yandex plans to develop alternative to ChatGPT neural network". Tass. 1 فبراير 2023. مؤرشف من الأصل في 2023-02-14.

روابط خارجية

- الموقع الرسمي

- الورقة البيضاء لإنستراكت جي بي تي، الذي سبق شات جي بي تي

| شات جي بي تي في المشاريع الشقيقة: | |